Upload README.md

Browse files

README.md

ADDED

|

@@ -0,0 +1,576 @@

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

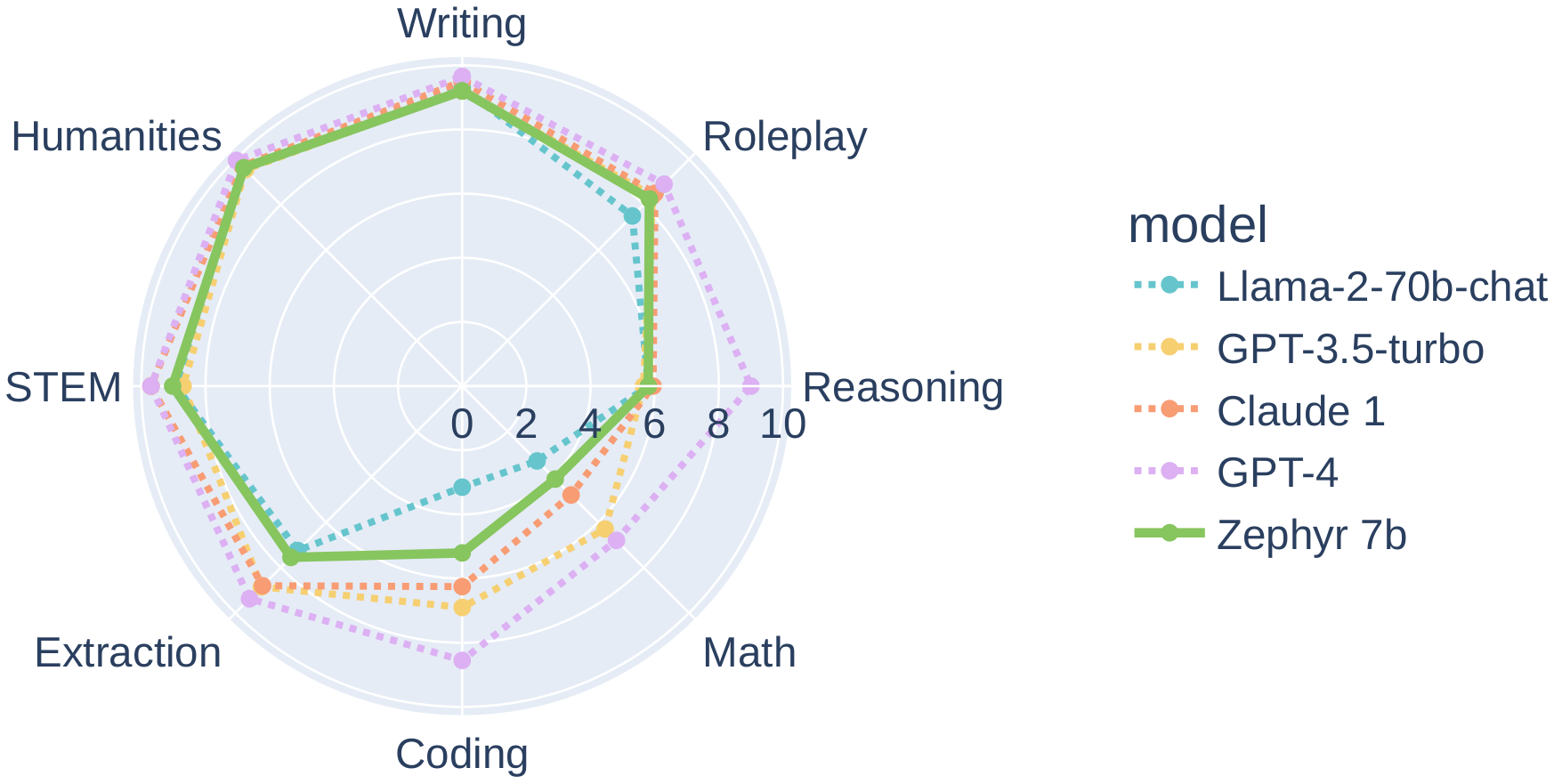

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

| 1 |

+

---

|

| 2 |

+

base_model: HuggingFaceH4/zephyr-7b-beta

|

| 3 |

+

datasets:

|

| 4 |

+

- HuggingFaceH4/ultrachat_200k

|

| 5 |

+

- HuggingFaceH4/ultrafeedback_binarized

|

| 6 |

+

inference: false

|

| 7 |

+

language:

|

| 8 |

+

- en

|

| 9 |

+

license: mit

|

| 10 |

+

model-index:

|

| 11 |

+

- name: zephyr-7b-beta

|

| 12 |

+

results: []

|

| 13 |

+

model_creator: Hugging Face H4

|

| 14 |

+

model_name: Zephyr 7B Beta

|

| 15 |

+

model_type: mistral

|

| 16 |

+

prompt_template: '<|system|>

|

| 17 |

+

|

| 18 |

+

</s>

|

| 19 |

+

|

| 20 |

+

<|user|>

|

| 21 |

+

|

| 22 |

+

{prompt}</s>

|

| 23 |

+

|

| 24 |

+

<|assistant|>

|

| 25 |

+

|

| 26 |

+

'

|

| 27 |

+

quantized_by: TheBloke

|

| 28 |

+

tags:

|

| 29 |

+

- generated_from_trainer

|

| 30 |

+

---

|

| 31 |

+

<!-- markdownlint-disable MD041 -->

|

| 32 |

+

|

| 33 |

+

<!-- header start -->

|

| 34 |

+

<!-- 200823 -->

|

| 35 |

+

<div style="width: auto; margin-left: auto; margin-right: auto">

|

| 36 |

+

<img src="https://i.imgur.com/EBdldam.jpg" alt="TheBlokeAI" style="width: 100%; min-width: 400px; display: block; margin: auto;">

|

| 37 |

+

</div>

|

| 38 |

+

<div style="display: flex; justify-content: space-between; width: 100%;">

|

| 39 |

+

<div style="display: flex; flex-direction: column; align-items: flex-start;">

|

| 40 |

+

<p style="margin-top: 0.5em; margin-bottom: 0em;"><a href="https://discord.gg/theblokeai">Chat & support: TheBloke's Discord server</a></p>

|

| 41 |

+

</div>

|

| 42 |

+

<div style="display: flex; flex-direction: column; align-items: flex-end;">

|

| 43 |

+

<p style="margin-top: 0.5em; margin-bottom: 0em;"><a href="https://www.patreon.com/TheBlokeAI">Want to contribute? TheBloke's Patreon page</a></p>

|

| 44 |

+

</div>

|

| 45 |

+

</div>

|

| 46 |

+

<div style="text-align:center; margin-top: 0em; margin-bottom: 0em"><p style="margin-top: 0.25em; margin-bottom: 0em;">TheBloke's LLM work is generously supported by a grant from <a href="https://a16z.com">andreessen horowitz (a16z)</a></p></div>

|

| 47 |

+

<hr style="margin-top: 1.0em; margin-bottom: 1.0em;">

|

| 48 |

+

<!-- header end -->

|

| 49 |

+

|

| 50 |

+

# Zephyr 7B Beta - AWQ

|

| 51 |

+

- Model creator: [Hugging Face H4](https://huggingface.co/HuggingFaceH4)

|

| 52 |

+

- Original model: [Zephyr 7B Beta](https://huggingface.co/HuggingFaceH4/zephyr-7b-beta)

|

| 53 |

+

|

| 54 |

+

<!-- description start -->

|

| 55 |

+

## Description

|

| 56 |

+

|

| 57 |

+

This repo contains AWQ model files for [Hugging Face H4's Zephyr 7B Beta](https://huggingface.co/HuggingFaceH4/zephyr-7b-beta).

|

| 58 |

+

|

| 59 |

+

|

| 60 |

+

### About AWQ

|

| 61 |

+

|

| 62 |

+

AWQ is an efficient, accurate and blazing-fast low-bit weight quantization method, currently supporting 4-bit quantization. Compared to GPTQ, it offers faster Transformers-based inference with equivalent or better quality compared to the most commonly used GPTQ settings.

|

| 63 |

+

|

| 64 |

+

It is supported by:

|

| 65 |

+

|

| 66 |

+

- [Text Generation Webui](https://github.com/oobabooga/text-generation-webui) - using Loader: AutoAWQ

|

| 67 |

+

- [vLLM](https://github.com/vllm-project/vllm) - Llama and Mistral models only

|

| 68 |

+

- [Hugging Face Text Generation Inference (TGI)](https://github.com/huggingface/text-generation-inference)

|

| 69 |

+

- [AutoAWQ](https://github.com/casper-hansen/AutoAWQ) - for use from Python code

|

| 70 |

+

|

| 71 |

+

<!-- description end -->

|

| 72 |

+

<!-- repositories-available start -->

|

| 73 |

+

## Repositories available

|

| 74 |

+

|

| 75 |

+

* [AWQ model(s) for GPU inference.](https://huggingface.co/TheBloke/zephyr-7B-beta-AWQ)

|

| 76 |

+

* [GPTQ models for GPU inference, with multiple quantisation parameter options.](https://huggingface.co/TheBloke/zephyr-7B-beta-GPTQ)

|

| 77 |

+

* [2, 3, 4, 5, 6 and 8-bit GGUF models for CPU+GPU inference](https://huggingface.co/TheBloke/zephyr-7B-beta-GGUF)

|

| 78 |

+

* [Hugging Face H4's original unquantised fp16 model in pytorch format, for GPU inference and for further conversions](https://huggingface.co/HuggingFaceH4/zephyr-7b-beta)

|

| 79 |

+

<!-- repositories-available end -->

|

| 80 |

+

|

| 81 |

+

<!-- prompt-template start -->

|

| 82 |

+

## Prompt template: Zephyr

|

| 83 |

+

|

| 84 |

+

```

|

| 85 |

+

<|system|>

|

| 86 |

+

</s>

|

| 87 |

+

<|user|>

|

| 88 |

+

{prompt}</s>

|

| 89 |

+

<|assistant|>

|

| 90 |

+

|

| 91 |

+

```

|

| 92 |

+

|

| 93 |

+

<!-- prompt-template end -->

|

| 94 |

+

|

| 95 |

+

|

| 96 |

+

<!-- README_AWQ.md-provided-files start -->

|

| 97 |

+

## Provided files, and AWQ parameters

|

| 98 |

+

|

| 99 |

+

For my first release of AWQ models, I am releasing 128g models only. I will consider adding 32g as well if there is interest, and once I have done perplexity and evaluation comparisons, but at this time 32g models are still not fully tested with AutoAWQ and vLLM.

|

| 100 |

+

|

| 101 |

+

Models are released as sharded safetensors files.

|

| 102 |

+

|

| 103 |

+

| Branch | Bits | GS | AWQ Dataset | Seq Len | Size |

|

| 104 |

+

| ------ | ---- | -- | ----------- | ------- | ---- |

|

| 105 |

+

| [main](https://huggingface.co/TheBloke/zephyr-7B-beta-AWQ/tree/main) | 4 | 128 | [wikitext](https://huggingface.co/datasets/wikitext/viewer/wikitext-2-v1/test) | 4096 | 4.15 GB

|

| 106 |

+

|

| 107 |

+

<!-- README_AWQ.md-provided-files end -->

|

| 108 |

+

|

| 109 |

+

<!-- README_AWQ.md-text-generation-webui start -->

|

| 110 |

+

## How to easily download and use this model in [text-generation-webui](https://github.com/oobabooga/text-generation-webui)

|

| 111 |

+

|

| 112 |

+

Please make sure you're using the latest version of [text-generation-webui](https://github.com/oobabooga/text-generation-webui).

|

| 113 |

+

|

| 114 |

+

It is strongly recommended to use the text-generation-webui one-click-installers unless you're sure you know how to make a manual install.

|

| 115 |

+

|

| 116 |

+

1. Click the **Model tab**.

|

| 117 |

+

2. Under **Download custom model or LoRA**, enter `TheBloke/zephyr-7B-beta-AWQ`.

|

| 118 |

+

3. Click **Download**.

|

| 119 |

+

4. The model will start downloading. Once it's finished it will say "Done".

|

| 120 |

+

5. In the top left, click the refresh icon next to **Model**.

|

| 121 |

+

6. In the **Model** dropdown, choose the model you just downloaded: `zephyr-7B-beta-AWQ`

|

| 122 |

+

7. Select **Loader: AutoAWQ**.

|

| 123 |

+

8. Click Load, and the model will load and is now ready for use.

|

| 124 |

+

9. If you want any custom settings, set them and then click **Save settings for this model** followed by **Reload the Model** in the top right.

|

| 125 |

+

10. Once you're ready, click the **Text Generation** tab and enter a prompt to get started!

|

| 126 |

+

<!-- README_AWQ.md-text-generation-webui end -->

|

| 127 |

+

|

| 128 |

+

<!-- README_AWQ.md-use-from-vllm start -->

|

| 129 |

+

## Multi-user inference server: vLLM

|

| 130 |

+

|

| 131 |

+

Documentation on installing and using vLLM [can be found here](https://vllm.readthedocs.io/en/latest/).

|

| 132 |

+

|

| 133 |

+

- Please ensure you are using vLLM version 0.2 or later.

|

| 134 |

+

- When using vLLM as a server, pass the `--quantization awq` parameter.

|

| 135 |

+

|

| 136 |

+

For example:

|

| 137 |

+

|

| 138 |

+

```shell

|

| 139 |

+

python3 python -m vllm.entrypoints.api_server --model TheBloke/zephyr-7B-beta-AWQ --quantization awq

|

| 140 |

+

```

|

| 141 |

+

|

| 142 |

+

- When using vLLM from Python code, again set `quantization=awq`.

|

| 143 |

+

|

| 144 |

+

For example:

|

| 145 |

+

|

| 146 |

+

```python

|

| 147 |

+

from vllm import LLM, SamplingParams

|

| 148 |

+

|

| 149 |

+

prompts = [

|

| 150 |

+

"Tell me about AI",

|

| 151 |

+

"Write a story about llamas",

|

| 152 |

+

"What is 291 - 150?",

|

| 153 |

+

"How much wood would a woodchuck chuck if a woodchuck could chuck wood?",

|

| 154 |

+

]

|

| 155 |

+

prompt_template=f'''<|system|>

|

| 156 |

+

</s>

|

| 157 |

+

<|user|>

|

| 158 |

+

{prompt}</s>

|

| 159 |

+

<|assistant|>

|

| 160 |

+

'''

|

| 161 |

+

|

| 162 |

+

prompts = [prompt_template.format(prompt=prompt) for prompt in prompts]

|

| 163 |

+

|

| 164 |

+

sampling_params = SamplingParams(temperature=0.8, top_p=0.95)

|

| 165 |

+

|

| 166 |

+

llm = LLM(model="TheBloke/zephyr-7B-beta-AWQ", quantization="awq", dtype="auto")

|

| 167 |

+

|

| 168 |

+

outputs = llm.generate(prompts, sampling_params)

|

| 169 |

+

|

| 170 |

+

# Print the outputs.

|

| 171 |

+

for output in outputs:

|

| 172 |

+

prompt = output.prompt

|

| 173 |

+

generated_text = output.outputs[0].text

|

| 174 |

+

print(f"Prompt: {prompt!r}, Generated text: {generated_text!r}")

|

| 175 |

+

```

|

| 176 |

+

<!-- README_AWQ.md-use-from-vllm start -->

|

| 177 |

+

|

| 178 |

+

<!-- README_AWQ.md-use-from-tgi start -->

|

| 179 |

+

## Multi-user inference server: Hugging Face Text Generation Inference (TGI)

|

| 180 |

+

|

| 181 |

+

Use TGI version 1.1.0 or later. The official Docker container is: `ghcr.io/huggingface/text-generation-inference:1.1.0`

|

| 182 |

+

|

| 183 |

+

Example Docker parameters:

|

| 184 |

+

|

| 185 |

+

```shell

|

| 186 |

+

--model-id TheBloke/zephyr-7B-beta-AWQ --port 3000 --quantize awq --max-input-length 3696 --max-total-tokens 4096 --max-batch-prefill-tokens 4096

|

| 187 |

+

```

|

| 188 |

+

|

| 189 |

+

Example Python code for interfacing with TGI (requires [huggingface-hub](https://github.com/huggingface/huggingface_hub) 0.17.0 or later):

|

| 190 |

+

|

| 191 |

+

```shell

|

| 192 |

+

pip3 install huggingface-hub

|

| 193 |

+

```

|

| 194 |

+

|

| 195 |

+

```python

|

| 196 |

+

from huggingface_hub import InferenceClient

|

| 197 |

+

|

| 198 |

+

endpoint_url = "https://your-endpoint-url-here"

|

| 199 |

+

|

| 200 |

+

prompt = "Tell me about AI"

|

| 201 |

+

prompt_template=f'''<|system|>

|

| 202 |

+

</s>

|

| 203 |

+

<|user|>

|

| 204 |

+

{prompt}</s>

|

| 205 |

+

<|assistant|>

|

| 206 |

+

'''

|

| 207 |

+

|

| 208 |

+

client = InferenceClient(endpoint_url)

|

| 209 |

+

response = client.text_generation(prompt,

|

| 210 |

+

max_new_tokens=128,

|

| 211 |

+

do_sample=True,

|

| 212 |

+

temperature=0.7,

|

| 213 |

+

top_p=0.95,

|

| 214 |

+

top_k=40,

|

| 215 |

+

repetition_penalty=1.1)

|

| 216 |

+

|

| 217 |

+

print(f"Model output: ", response)

|

| 218 |

+

```

|

| 219 |

+

<!-- README_AWQ.md-use-from-tgi end -->

|

| 220 |

+

|

| 221 |

+

<!-- README_AWQ.md-use-from-python start -->

|

| 222 |

+

## Inference from Python code using AutoAWQ

|

| 223 |

+

|

| 224 |

+

### Install the AutoAWQ package

|

| 225 |

+

|

| 226 |

+

Requires: [AutoAWQ](https://github.com/casper-hansen/AutoAWQ) 0.1.1 or later.

|

| 227 |

+

|

| 228 |

+

```shell

|

| 229 |

+

pip3 install autoawq

|

| 230 |

+

```

|

| 231 |

+

|

| 232 |

+

If you have problems installing [AutoAWQ](https://github.com/casper-hansen/AutoAWQ) using the pre-built wheels, install it from source instead:

|

| 233 |

+

|

| 234 |

+

```shell

|

| 235 |

+

pip3 uninstall -y autoawq

|

| 236 |

+

git clone https://github.com/casper-hansen/AutoAWQ

|

| 237 |

+

cd AutoAWQ

|

| 238 |

+

pip3 install .

|

| 239 |

+

```

|

| 240 |

+

|

| 241 |

+

### AutoAWQ example code

|

| 242 |

+

|

| 243 |

+

```python

|

| 244 |

+

from awq import AutoAWQForCausalLM

|

| 245 |

+

from transformers import AutoTokenizer

|

| 246 |

+

|

| 247 |

+

model_name_or_path = "TheBloke/zephyr-7B-beta-AWQ"

|

| 248 |

+

|

| 249 |

+

# Load tokenizer

|

| 250 |

+

tokenizer = AutoTokenizer.from_pretrained(model_name_or_path, trust_remote_code=False)

|

| 251 |

+

# Load model

|

| 252 |

+

model = AutoAWQForCausalLM.from_quantized(model_name_or_path, fuse_layers=True,

|

| 253 |

+

trust_remote_code=False, safetensors=True)

|

| 254 |

+

|

| 255 |

+

prompt = "Tell me about AI"

|

| 256 |

+

prompt_template=f'''<|system|>

|

| 257 |

+

</s>

|

| 258 |

+

<|user|>

|

| 259 |

+

{prompt}</s>

|

| 260 |

+

<|assistant|>

|

| 261 |

+

'''

|

| 262 |

+

|

| 263 |

+

print("*** Running model.generate:")

|

| 264 |

+

|

| 265 |

+

token_input = tokenizer(

|

| 266 |

+

prompt_template,

|

| 267 |

+

return_tensors='pt'

|

| 268 |

+

).input_ids.cuda()

|

| 269 |

+

|

| 270 |

+

# Generate output

|

| 271 |

+

generation_output = model.generate(

|

| 272 |

+

token_input,

|

| 273 |

+

do_sample=True,

|

| 274 |

+

temperature=0.7,

|

| 275 |

+

top_p=0.95,

|

| 276 |

+

top_k=40,

|

| 277 |

+

max_new_tokens=512

|

| 278 |

+

)

|

| 279 |

+

|

| 280 |

+

# Get the tokens from the output, decode them, print them

|

| 281 |

+

token_output = generation_output[0]

|

| 282 |

+

text_output = tokenizer.decode(token_output)

|

| 283 |

+

print("LLM output: ", text_output)

|

| 284 |

+

|

| 285 |

+

"""

|

| 286 |

+

# Inference should be possible with transformers pipeline as well in future

|

| 287 |

+

# But currently this is not yet supported by AutoAWQ (correct as of September 25th 2023)

|

| 288 |

+

from transformers import pipeline

|

| 289 |

+

|

| 290 |

+

print("*** Pipeline:")

|

| 291 |

+

pipe = pipeline(

|

| 292 |

+

"text-generation",

|

| 293 |

+

model=model,

|

| 294 |

+

tokenizer=tokenizer,

|

| 295 |

+

max_new_tokens=512,

|

| 296 |

+

do_sample=True,

|

| 297 |

+

temperature=0.7,

|

| 298 |

+

top_p=0.95,

|

| 299 |

+

top_k=40,

|

| 300 |

+

repetition_penalty=1.1

|

| 301 |

+

)

|

| 302 |

+

|

| 303 |

+

print(pipe(prompt_template)[0]['generated_text'])

|

| 304 |

+

"""

|

| 305 |

+

```

|

| 306 |

+

<!-- README_AWQ.md-use-from-python end -->

|

| 307 |

+

|

| 308 |

+

<!-- README_AWQ.md-compatibility start -->

|

| 309 |

+

## Compatibility

|

| 310 |

+

|

| 311 |

+

The files provided are tested to work with:

|

| 312 |

+

|

| 313 |

+

- [text-generation-webui](https://github.com/oobabooga/text-generation-webui) using `Loader: AutoAWQ`.

|

| 314 |

+

- [vLLM](https://github.com/vllm-project/vllm) version 0.2.0 and later.

|

| 315 |

+

- [Hugging Face Text Generation Inference (TGI)](https://github.com/huggingface/text-generation-inference) version 1.1.0 and later.

|

| 316 |

+

- [AutoAWQ](https://github.com/casper-hansen/AutoAWQ) version 0.1.1 and later.

|

| 317 |

+

|

| 318 |

+

<!-- README_AWQ.md-compatibility end -->

|

| 319 |

+

|

| 320 |

+

<!-- footer start -->

|

| 321 |

+

<!-- 200823 -->

|

| 322 |

+

## Discord

|

| 323 |

+

|

| 324 |

+

For further support, and discussions on these models and AI in general, join us at:

|

| 325 |

+

|

| 326 |

+

[TheBloke AI's Discord server](https://discord.gg/theblokeai)

|

| 327 |

+

|

| 328 |

+

## Thanks, and how to contribute

|

| 329 |

+

|

| 330 |

+

Thanks to the [chirper.ai](https://chirper.ai) team!

|

| 331 |

+

|

| 332 |

+

Thanks to Clay from [gpus.llm-utils.org](llm-utils)!

|

| 333 |

+

|

| 334 |

+

I've had a lot of people ask if they can contribute. I enjoy providing models and helping people, and would love to be able to spend even more time doing it, as well as expanding into new projects like fine tuning/training.

|

| 335 |

+

|

| 336 |

+

If you're able and willing to contribute it will be most gratefully received and will help me to keep providing more models, and to start work on new AI projects.

|

| 337 |

+

|

| 338 |

+

Donaters will get priority support on any and all AI/LLM/model questions and requests, access to a private Discord room, plus other benefits.

|

| 339 |

+

|

| 340 |

+

* Patreon: https://patreon.com/TheBlokeAI

|

| 341 |

+

* Ko-Fi: https://ko-fi.com/TheBlokeAI

|

| 342 |

+

|

| 343 |

+

**Special thanks to**: Aemon Algiz.

|

| 344 |

+

|

| 345 |

+

**Patreon special mentions**: Pierre Kircher, Stanislav Ovsiannikov, Michael Levine, Eugene Pentland, Andrey, 준교 김, Randy H, Fred von Graf, Artur Olbinski, Caitlyn Gatomon, terasurfer, Jeff Scroggin, James Bentley, Vadim, Gabriel Puliatti, Harry Royden McLaughlin, Sean Connelly, Dan Guido, Edmond Seymore, Alicia Loh, subjectnull, AzureBlack, Manuel Alberto Morcote, Thomas Belote, Lone Striker, Chris Smitley, Vitor Caleffi, Johann-Peter Hartmann, Clay Pascal, biorpg, Brandon Frisco, sidney chen, transmissions 11, Pedro Madruga, jinyuan sun, Ajan Kanaga, Emad Mostaque, Trenton Dambrowitz, Jonathan Leane, Iucharbius, usrbinkat, vamX, George Stoitzev, Luke Pendergrass, theTransient, Olakabola, Swaroop Kallakuri, Cap'n Zoog, Brandon Phillips, Michael Dempsey, Nikolai Manek, danny, Matthew Berman, Gabriel Tamborski, alfie_i, Raymond Fosdick, Tom X Nguyen, Raven Klaugh, LangChain4j, Magnesian, Illia Dulskyi, David Ziegler, Mano Prime, Luis Javier Navarrete Lozano, Erik Bjäreholt, 阿明, Nathan Dryer, Alex, Rainer Wilmers, zynix, TL, Joseph William Delisle, John Villwock, Nathan LeClaire, Willem Michiel, Joguhyik, GodLy, OG, Alps Aficionado, Jeffrey Morgan, ReadyPlayerEmma, Tiffany J. Kim, Sebastain Graf, Spencer Kim, Michael Davis, webtim, Talal Aujan, knownsqashed, John Detwiler, Imad Khwaja, Deo Leter, Jerry Meng, Elijah Stavena, Rooh Singh, Pieter, SuperWojo, Alexandros Triantafyllidis, Stephen Murray, Ai Maven, ya boyyy, Enrico Ros, Ken Nordquist, Deep Realms, Nicholas, Spiking Neurons AB, Elle, Will Dee, Jack West, RoA, Luke @flexchar, Viktor Bowallius, Derek Yates, Subspace Studios, jjj, Toran Billups, Asp the Wyvern, Fen Risland, Ilya, NimbleBox.ai, Chadd, Nitin Borwankar, Emre, Mandus, Leonard Tan, Kalila, K, Trailburnt, S_X, Cory Kujawski

|

| 346 |

+

|

| 347 |

+

|

| 348 |

+

Thank you to all my generous patrons and donaters!

|

| 349 |

+

|

| 350 |

+

And thank you again to a16z for their generous grant.

|

| 351 |

+

|

| 352 |

+

<!-- footer end -->

|

| 353 |

+

|

| 354 |

+

# Original model card: Hugging Face H4's Zephyr 7B Beta

|

| 355 |

+

|

| 356 |

+

|

| 357 |

+

<!-- This model card has been generated automatically according to the information the Trainer had access to. You

|

| 358 |

+

should probably proofread and complete it, then remove this comment. -->

|

| 359 |

+

|

| 360 |

+

<img src="https://huggingface.co/HuggingFaceH4/zephyr-7b-alpha/resolve/main/thumbnail.png" alt="Zephyr Logo" width="800" style="margin-left:'auto' margin-right:'auto' display:'block'"/>

|

| 361 |

+

|

| 362 |

+

|

| 363 |

+

# Model Card for Zephyr 7B β

|

| 364 |

+

|

| 365 |

+

Zephyr is a series of language models that are trained to act as helpful assistants. Zephyr-7B-β is the second model in the series, and is a fine-tuned version of [mistralai/Mistral-7B-v0.1](https://huggingface.co/mistralai/Mistral-7B-v0.1) that was trained on on a mix of publicly available, synthetic datasets using [Direct Preference Optimization (DPO)](https://arxiv.org/abs/2305.18290). We found that removing the in-built alignment of these datasets boosted performance on [MT Bench](https://huggingface.co/spaces/lmsys/mt-bench) and made the model more helpful. However, this means that model is likely to generate problematic text when prompted to do so and should only be used for educational and research purposes. You can find more details in the [technical report](https://arxiv.org/abs/2310.16944).

|

| 366 |

+

|

| 367 |

+

|

| 368 |

+

## Model description

|

| 369 |

+

|

| 370 |

+

- **Model type:** A 7B parameter GPT-like model fine-tuned on a mix of publicly available, synthetic datasets.

|

| 371 |

+

- **Language(s) (NLP):** Primarily English

|

| 372 |

+

- **License:** MIT

|

| 373 |

+

- **Finetuned from model:** [mistralai/Mistral-7B-v0.1](https://huggingface.co/mistralai/Mistral-7B-v0.1)

|

| 374 |

+

|

| 375 |

+

### Model Sources

|

| 376 |

+

|

| 377 |

+

<!-- Provide the basic links for the model. -->

|

| 378 |

+

|

| 379 |

+

- **Repository:** https://github.com/huggingface/alignment-handbook

|

| 380 |

+

- **Demo:** https://huggingface.co/spaces/HuggingFaceH4/zephyr-chat

|

| 381 |

+

- **Chatbot Arena:** Evaluate Zephyr 7B against 10+ LLMs in the LMSYS arena: http://arena.lmsys.org

|

| 382 |

+

|

| 383 |

+

## Performance

|

| 384 |

+

|

| 385 |

+

At the time of release, Zephyr-7B-β is the highest ranked 7B chat model on the [MT-Bench](https://huggingface.co/spaces/lmsys/mt-bench) and [AlpacaEval](https://tatsu-lab.github.io/alpaca_eval/) benchmarks:

|

| 386 |

+

|

| 387 |

+

| Model | Size | Alignment | MT-Bench (score) | AlpacaEval (win rate %) |

|

| 388 |

+

|-------------|-----|----|---------------|--------------|

|

| 389 |

+

| StableLM-Tuned-α | 7B| dSFT |2.75| -|

|

| 390 |

+

| MPT-Chat | 7B |dSFT |5.42| -|

|

| 391 |

+

| Xwin-LMv0.1 | 7B| dPPO| 6.19| 87.83|

|

| 392 |

+

| Mistral-Instructv0.1 | 7B| - | 6.84 |-|

|

| 393 |

+

| Zephyr-7b-α |7B| dDPO| 6.88| -|

|

| 394 |

+

| **Zephyr-7b-β** 🪁 | **7B** | **dDPO** | **7.34** | **90.60** |

|

| 395 |

+

| Falcon-Instruct | 40B |dSFT |5.17 |45.71|

|

| 396 |

+

| Guanaco | 65B | SFT |6.41| 71.80|

|

| 397 |

+

| Llama2-Chat | 70B |RLHF |6.86| 92.66|

|

| 398 |

+

| Vicuna v1.3 | 33B |dSFT |7.12 |88.99|

|

| 399 |

+

| WizardLM v1.0 | 70B |dSFT |7.71 |-|

|

| 400 |

+

| Xwin-LM v0.1 | 70B |dPPO |- |95.57|

|

| 401 |

+

| GPT-3.5-turbo | - |RLHF |7.94 |89.37|

|

| 402 |

+

| Claude 2 | - |RLHF |8.06| 91.36|

|

| 403 |

+

| GPT-4 | -| RLHF |8.99| 95.28|

|

| 404 |

+

|

| 405 |

+

In particular, on several categories of MT-Bench, Zephyr-7B-β has strong performance compared to larger open models like Llama2-Chat-70B:

|

| 406 |

+

|

| 407 |

+

|

| 408 |

+

|

| 409 |

+

However, on more complex tasks like coding and mathematics, Zephyr-7B-β lags behind proprietary models and more research is needed to close the gap.

|

| 410 |

+

|

| 411 |

+

|

| 412 |

+

## Intended uses & limitations

|

| 413 |

+

|

| 414 |

+

The model was initially fine-tuned on a filtered and preprocessed of the [`UltraChat`](https://huggingface.co/datasets/stingning/ultrachat) dataset, which contains a diverse range of synthetic dialogues generated by ChatGPT.

|

| 415 |

+

We then further aligned the model with [🤗 TRL's](https://github.com/huggingface/trl) `DPOTrainer` on the [openbmb/UltraFeedback](https://huggingface.co/datasets/openbmb/UltraFeedback) dataset, which contains 64k prompts and model completions that are ranked by GPT-4. As a result, the model can be used for chat and you can check out our [demo](https://huggingface.co/spaces/HuggingFaceH4/zephyr-chat) to test its capabilities.

|

| 416 |

+

|

| 417 |

+

You can find the datasets used for training Zephyr-7B-β [here](https://huggingface.co/collections/HuggingFaceH4/zephyr-7b-6538c6d6d5ddd1cbb1744a66)

|

| 418 |

+

|

| 419 |

+

Here's how you can run the model using the `pipeline()` function from 🤗 Transformers:

|

| 420 |

+

|

| 421 |

+

```python

|

| 422 |

+

# Install transformers from source - only needed for versions <= v4.34

|

| 423 |

+

# pip install git+https://github.com/huggingface/transformers.git

|

| 424 |

+

# pip install accelerate

|

| 425 |

+

|

| 426 |

+

import torch

|

| 427 |

+

from transformers import pipeline

|

| 428 |

+

|

| 429 |

+

pipe = pipeline("text-generation", model="HuggingFaceH4/zephyr-7b-beta", torch_dtype=torch.bfloat16, device_map="auto")

|

| 430 |

+

|

| 431 |

+

# We use the tokenizer's chat template to format each message - see https://huggingface.co/docs/transformers/main/en/chat_templating

|

| 432 |

+

messages = [

|

| 433 |

+

{

|

| 434 |

+

"role": "system",

|

| 435 |

+

"content": "You are a friendly chatbot who always responds in the style of a pirate",

|

| 436 |

+

},

|

| 437 |

+

{"role": "user", "content": "How many helicopters can a human eat in one sitting?"},

|

| 438 |

+

]

|

| 439 |

+

prompt = pipe.tokenizer.apply_chat_template(messages, tokenize=False, add_generation_prompt=True)

|

| 440 |

+

outputs = pipe(prompt, max_new_tokens=256, do_sample=True, temperature=0.7, top_k=50, top_p=0.95)

|

| 441 |

+

print(outputs[0]["generated_text"])

|

| 442 |

+

# <|system|>

|

| 443 |

+

# You are a friendly chatbot who always responds in the style of a pirate.</s>

|

| 444 |

+

# <|user|>

|

| 445 |

+

# How many helicopters can a human eat in one sitting?</s>

|

| 446 |

+

# <|assistant|>

|

| 447 |

+

# Ah, me hearty matey! But yer question be a puzzler! A human cannot eat a helicopter in one sitting, as helicopters are not edible. They be made of metal, plastic, and other materials, not food!

|

| 448 |

+

```

|

| 449 |

+

|

| 450 |

+

## Bias, Risks, and Limitations

|

| 451 |

+

|

| 452 |

+

<!-- This section is meant to convey both technical and sociotechnical limitations. -->

|

| 453 |

+

|

| 454 |

+

Zephyr-7B-β has not been aligned to human preferences with techniques like RLHF or deployed with in-the-loop filtering of responses like ChatGPT, so the model can produce problematic outputs (especially when prompted to do so).

|

| 455 |

+

It is also unknown what the size and composition of the corpus was used to train the base model (`mistralai/Mistral-7B-v0.1`), however it is likely to have included a mix of Web data and technical sources like books and code. See the [Falcon 180B model card](https://huggingface.co/tiiuae/falcon-180B#training-data) for an example of this.

|

| 456 |

+

|

| 457 |

+

|

| 458 |

+

## Training and evaluation data

|

| 459 |

+

|

| 460 |

+

During DPO training, this model achieves the following results on the evaluation set:

|

| 461 |

+

|

| 462 |

+

- Loss: 0.7496

|

| 463 |

+

- Rewards/chosen: -4.5221

|

| 464 |

+

- Rewards/rejected: -8.3184

|

| 465 |

+

- Rewards/accuracies: 0.7812

|

| 466 |

+

- Rewards/margins: 3.7963

|

| 467 |

+

- Logps/rejected: -340.1541

|

| 468 |

+

- Logps/chosen: -299.4561

|

| 469 |

+

- Logits/rejected: -2.3081

|

| 470 |

+

- Logits/chosen: -2.3531

|

| 471 |

+

|

| 472 |

+

|

| 473 |

+

### Training hyperparameters

|

| 474 |

+

|

| 475 |

+

The following hyperparameters were used during training:

|

| 476 |

+

- learning_rate: 5e-07

|

| 477 |

+

- train_batch_size: 2

|

| 478 |

+

- eval_batch_size: 4

|

| 479 |

+

- seed: 42

|

| 480 |

+

- distributed_type: multi-GPU

|

| 481 |

+

- num_devices: 16

|

| 482 |

+

- total_train_batch_size: 32

|

| 483 |

+

- total_eval_batch_size: 64

|

| 484 |

+

- optimizer: Adam with betas=(0.9,0.999) and epsilon=1e-08

|

| 485 |

+

- lr_scheduler_type: linear

|

| 486 |

+

- lr_scheduler_warmup_ratio: 0.1

|

| 487 |

+

- num_epochs: 3.0

|

| 488 |

+

|

| 489 |

+

### Training results

|

| 490 |

+

|

| 491 |

+

The table below shows the full set of DPO training metrics:

|

| 492 |

+

|

| 493 |

+

|

| 494 |

+

| Training Loss | Epoch | Step | Validation Loss | Rewards/chosen | Rewards/rejected | Rewards/accuracies | Rewards/margins | Logps/rejected | Logps/chosen | Logits/rejected | Logits/chosen |

|

| 495 |

+

|:-------------:|:-----:|:----:|:---------------:|:--------------:|:----------------:|:------------------:|:---------------:|:--------------:|:------------:|:---------------:|:-------------:|

|

| 496 |

+

| 0.6284 | 0.05 | 100 | 0.6098 | 0.0425 | -0.1872 | 0.7344 | 0.2297 | -258.8416 | -253.8099 | -2.7976 | -2.8234 |

|

| 497 |

+

| 0.4908 | 0.1 | 200 | 0.5426 | -0.0279 | -0.6842 | 0.75 | 0.6563 | -263.8124 | -254.5145 | -2.7719 | -2.7960 |

|

| 498 |

+

| 0.5264 | 0.15 | 300 | 0.5324 | 0.0414 | -0.9793 | 0.7656 | 1.0207 | -266.7627 | -253.8209 | -2.7892 | -2.8122 |

|

| 499 |

+

| 0.5536 | 0.21 | 400 | 0.4957 | -0.0185 | -1.5276 | 0.7969 | 1.5091 | -272.2460 | -254.4203 | -2.8542 | -2.8764 |

|

| 500 |

+

| 0.5362 | 0.26 | 500 | 0.5031 | -0.2630 | -1.5917 | 0.7812 | 1.3287 | -272.8869 | -256.8653 | -2.8702 | -2.8958 |

|

| 501 |

+

| 0.5966 | 0.31 | 600 | 0.5963 | -0.2993 | -1.6491 | 0.7812 | 1.3499 | -273.4614 | -257.2279 | -2.8778 | -2.8986 |

|

| 502 |

+

| 0.5014 | 0.36 | 700 | 0.5382 | -0.2859 | -1.4750 | 0.75 | 1.1891 | -271.7204 | -257.0942 | -2.7659 | -2.7869 |

|

| 503 |

+

| 0.5334 | 0.41 | 800 | 0.5677 | -0.4289 | -1.8968 | 0.7969 | 1.4679 | -275.9378 | -258.5242 | -2.7053 | -2.7265 |

|

| 504 |

+

| 0.5251 | 0.46 | 900 | 0.5772 | -0.2116 | -1.3107 | 0.7344 | 1.0991 | -270.0768 | -256.3507 | -2.8463 | -2.8662 |

|

| 505 |

+

| 0.5205 | 0.52 | 1000 | 0.5262 | -0.3792 | -1.8585 | 0.7188 | 1.4793 | -275.5552 | -258.0276 | -2.7893 | -2.7979 |

|

| 506 |

+

| 0.5094 | 0.57 | 1100 | 0.5433 | -0.6279 | -1.9368 | 0.7969 | 1.3089 | -276.3377 | -260.5136 | -2.7453 | -2.7536 |

|

| 507 |

+

| 0.5837 | 0.62 | 1200 | 0.5349 | -0.3780 | -1.9584 | 0.7656 | 1.5804 | -276.5542 | -258.0154 | -2.7643 | -2.7756 |

|

| 508 |

+

| 0.5214 | 0.67 | 1300 | 0.5732 | -1.0055 | -2.2306 | 0.7656 | 1.2251 | -279.2761 | -264.2903 | -2.6986 | -2.7113 |

|

| 509 |

+

| 0.6914 | 0.72 | 1400 | 0.5137 | -0.6912 | -2.1775 | 0.7969 | 1.4863 | -278.7448 | -261.1467 | -2.7166 | -2.7275 |

|

| 510 |

+

| 0.4655 | 0.77 | 1500 | 0.5090 | -0.7987 | -2.2930 | 0.7031 | 1.4943 | -279.8999 | -262.2220 | -2.6651 | -2.6838 |

|

| 511 |

+

| 0.5731 | 0.83 | 1600 | 0.5312 | -0.8253 | -2.3520 | 0.7812 | 1.5268 | -280.4902 | -262.4876 | -2.6543 | -2.6728 |

|

| 512 |

+

| 0.5233 | 0.88 | 1700 | 0.5206 | -0.4573 | -2.0951 | 0.7812 | 1.6377 | -277.9205 | -258.8084 | -2.6870 | -2.7097 |

|

| 513 |

+

| 0.5593 | 0.93 | 1800 | 0.5231 | -0.5508 | -2.2000 | 0.7969 | 1.6492 | -278.9703 | -259.7433 | -2.6221 | -2.6519 |

|

| 514 |

+

| 0.4967 | 0.98 | 1900 | 0.5290 | -0.5340 | -1.9570 | 0.8281 | 1.4230 | -276.5395 | -259.5749 | -2.6564 | -2.6878 |

|

| 515 |

+

| 0.0921 | 1.03 | 2000 | 0.5368 | -1.1376 | -3.1615 | 0.7812 | 2.0239 | -288.5854 | -265.6111 | -2.6040 | -2.6345 |

|

| 516 |

+

| 0.0733 | 1.08 | 2100 | 0.5453 | -1.1045 | -3.4451 | 0.7656 | 2.3406 | -291.4208 | -265.2799 | -2.6289 | -2.6595 |

|

| 517 |

+

| 0.0972 | 1.14 | 2200 | 0.5571 | -1.6915 | -3.9823 | 0.8125 | 2.2908 | -296.7934 | -271.1505 | -2.6471 | -2.6709 |

|

| 518 |

+

| 0.1058 | 1.19 | 2300 | 0.5789 | -1.0621 | -3.8941 | 0.7969 | 2.8319 | -295.9106 | -264.8563 | -2.5527 | -2.5798 |

|

| 519 |

+

| 0.2423 | 1.24 | 2400 | 0.5455 | -1.1963 | -3.5590 | 0.7812 | 2.3627 | -292.5599 | -266.1981 | -2.5414 | -2.5784 |

|

| 520 |

+

| 0.1177 | 1.29 | 2500 | 0.5889 | -1.8141 | -4.3942 | 0.7969 | 2.5801 | -300.9120 | -272.3761 | -2.4802 | -2.5189 |

|

| 521 |

+

| 0.1213 | 1.34 | 2600 | 0.5683 | -1.4608 | -3.8420 | 0.8125 | 2.3812 | -295.3901 | -268.8436 | -2.4774 | -2.5207 |

|

| 522 |

+

| 0.0889 | 1.39 | 2700 | 0.5890 | -1.6007 | -3.7337 | 0.7812 | 2.1330 | -294.3068 | -270.2423 | -2.4123 | -2.4522 |

|

| 523 |

+

| 0.0995 | 1.45 | 2800 | 0.6073 | -1.5519 | -3.8362 | 0.8281 | 2.2843 | -295.3315 | -269.7538 | -2.4685 | -2.5050 |

|

| 524 |

+

| 0.1145 | 1.5 | 2900 | 0.5790 | -1.7939 | -4.2876 | 0.8438 | 2.4937 | -299.8461 | -272.1744 | -2.4272 | -2.4674 |

|

| 525 |

+

| 0.0644 | 1.55 | 3000 | 0.5735 | -1.7285 | -4.2051 | 0.8125 | 2.4766 | -299.0209 | -271.5201 | -2.4193 | -2.4574 |

|

| 526 |

+

| 0.0798 | 1.6 | 3100 | 0.5537 | -1.7226 | -4.2850 | 0.8438 | 2.5624 | -299.8200 | -271.4610 | -2.5367 | -2.5696 |

|

| 527 |

+

| 0.1013 | 1.65 | 3200 | 0.5575 | -1.5715 | -3.9813 | 0.875 | 2.4098 | -296.7825 | -269.9498 | -2.4926 | -2.5267 |

|

| 528 |

+

| 0.1254 | 1.7 | 3300 | 0.5905 | -1.6412 | -4.4703 | 0.8594 | 2.8291 | -301.6730 | -270.6473 | -2.5017 | -2.5340 |

|

| 529 |

+

| 0.085 | 1.76 | 3400 | 0.6133 | -1.9159 | -4.6760 | 0.8438 | 2.7601 | -303.7296 | -273.3941 | -2.4614 | -2.4960 |

|

| 530 |

+

| 0.065 | 1.81 | 3500 | 0.6074 | -1.8237 | -4.3525 | 0.8594 | 2.5288 | -300.4951 | -272.4724 | -2.4597 | -2.5004 |

|

| 531 |

+

| 0.0755 | 1.86 | 3600 | 0.5836 | -1.9252 | -4.4005 | 0.8125 | 2.4753 | -300.9748 | -273.4872 | -2.4327 | -2.4716 |

|

| 532 |

+

| 0.0746 | 1.91 | 3700 | 0.5789 | -1.9280 | -4.4906 | 0.8125 | 2.5626 | -301.8762 | -273.5149 | -2.4686 | -2.5115 |

|

| 533 |

+

| 0.1348 | 1.96 | 3800 | 0.6015 | -1.8658 | -4.2428 | 0.8281 | 2.3769 | -299.3976 | -272.8936 | -2.4943 | -2.5393 |

|

| 534 |

+

| 0.0217 | 2.01 | 3900 | 0.6122 | -2.3335 | -4.9229 | 0.8281 | 2.5894 | -306.1988 | -277.5699 | -2.4841 | -2.5272 |

|

| 535 |

+

| 0.0219 | 2.07 | 4000 | 0.6522 | -2.9890 | -6.0164 | 0.8281 | 3.0274 | -317.1334 | -284.1248 | -2.4105 | -2.4545 |

|

| 536 |

+

| 0.0119 | 2.12 | 4100 | 0.6922 | -3.4777 | -6.6749 | 0.7969 | 3.1972 | -323.7187 | -289.0121 | -2.4272 | -2.4699 |

|

| 537 |

+

| 0.0153 | 2.17 | 4200 | 0.6993 | -3.2406 | -6.6775 | 0.7969 | 3.4369 | -323.7453 | -286.6413 | -2.4047 | -2.4465 |

|

| 538 |

+

| 0.011 | 2.22 | 4300 | 0.7178 | -3.7991 | -7.4397 | 0.7656 | 3.6406 | -331.3667 | -292.2260 | -2.3843 | -2.4290 |

|

| 539 |

+

| 0.0072 | 2.27 | 4400 | 0.6840 | -3.3269 | -6.8021 | 0.8125 | 3.4752 | -324.9908 | -287.5042 | -2.4095 | -2.4536 |

|

| 540 |

+

| 0.0197 | 2.32 | 4500 | 0.7013 | -3.6890 | -7.3014 | 0.8125 | 3.6124 | -329.9841 | -291.1250 | -2.4118 | -2.4543 |

|

| 541 |

+

| 0.0182 | 2.37 | 4600 | 0.7476 | -3.8994 | -7.5366 | 0.8281 | 3.6372 | -332.3356 | -293.2291 | -2.4163 | -2.4565 |

|

| 542 |

+

| 0.0125 | 2.43 | 4700 | 0.7199 | -4.0560 | -7.5765 | 0.8438 | 3.5204 | -332.7345 | -294.7952 | -2.3699 | -2.4100 |

|

| 543 |

+

| 0.0082 | 2.48 | 4800 | 0.7048 | -3.6613 | -7.1356 | 0.875 | 3.4743 | -328.3255 | -290.8477 | -2.3925 | -2.4303 |

|

| 544 |

+

| 0.0118 | 2.53 | 4900 | 0.6976 | -3.7908 | -7.3152 | 0.8125 | 3.5244 | -330.1224 | -292.1431 | -2.3633 | -2.4047 |

|

| 545 |

+

| 0.0118 | 2.58 | 5000 | 0.7198 | -3.9049 | -7.5557 | 0.8281 | 3.6508 | -332.5271 | -293.2844 | -2.3764 | -2.4194 |

|

| 546 |

+

| 0.006 | 2.63 | 5100 | 0.7506 | -4.2118 | -7.9149 | 0.8125 | 3.7032 | -336.1194 | -296.3530 | -2.3407 | -2.3860 |

|

| 547 |

+

| 0.0143 | 2.68 | 5200 | 0.7408 | -4.2433 | -7.9802 | 0.8125 | 3.7369 | -336.7721 | -296.6682 | -2.3509 | -2.3946 |

|

| 548 |

+

| 0.0057 | 2.74 | 5300 | 0.7552 | -4.3392 | -8.0831 | 0.7969 | 3.7439 | -337.8013 | -297.6275 | -2.3388 | -2.3842 |

|

| 549 |

+

| 0.0138 | 2.79 | 5400 | 0.7404 | -4.2395 | -7.9762 | 0.8125 | 3.7367 | -336.7322 | -296.6304 | -2.3286 | -2.3737 |

|

| 550 |

+

| 0.0079 | 2.84 | 5500 | 0.7525 | -4.4466 | -8.2196 | 0.7812 | 3.7731 | -339.1662 | -298.7007 | -2.3200 | -2.3641 |

|

| 551 |

+

| 0.0077 | 2.89 | 5600 | 0.7520 | -4.5586 | -8.3485 | 0.7969 | 3.7899 | -340.4545 | -299.8206 | -2.3078 | -2.3517 |

|

| 552 |

+

| 0.0094 | 2.94 | 5700 | 0.7527 | -4.5542 | -8.3509 | 0.7812 | 3.7967 | -340.4790 | -299.7773 | -2.3062 | -2.3510 |

|

| 553 |

+

| 0.0054 | 2.99 | 5800 | 0.7520 | -4.5169 | -8.3079 | 0.7812 | 3.7911 | -340.0493 | -299.4038 | -2.3081 | -2.3530 |

|

| 554 |

+

|

| 555 |

+

|

| 556 |

+

### Framework versions

|

| 557 |

+

|

| 558 |

+

- Transformers 4.35.0.dev0

|

| 559 |

+

- Pytorch 2.0.1+cu118

|

| 560 |

+

- Datasets 2.12.0

|

| 561 |

+

- Tokenizers 0.14.0

|

| 562 |

+

|

| 563 |

+

## Citation

|

| 564 |

+

|

| 565 |

+

If you find Zephyr-7B-β is useful in your work, please cite it with:

|

| 566 |

+

|

| 567 |

+

```

|

| 568 |

+

@misc{tunstall2023zephyr,

|

| 569 |

+

title={Zephyr: Direct Distillation of LM Alignment},

|

| 570 |

+

author={Lewis Tunstall and Edward Beeching and Nathan Lambert and Nazneen Rajani and Kashif Rasul and Younes Belkada and Shengyi Huang and Leandro von Werra and Clémentine Fourrier and Nathan Habib and Nathan Sarrazin and Omar Sanseviero and Alexander M. Rush and Thomas Wolf},

|

| 571 |

+

year={2023},

|

| 572 |

+

eprint={2310.16944},

|

| 573 |

+

archivePrefix={arXiv},

|

| 574 |

+

primaryClass={cs.LG}

|

| 575 |

+

}

|

| 576 |

+

```

|